3つの懸念をどう解消するか——GitLabが考える解決策

これらの懸念に対し、佐々木氏は、GitLabが考える解決策を提示した。

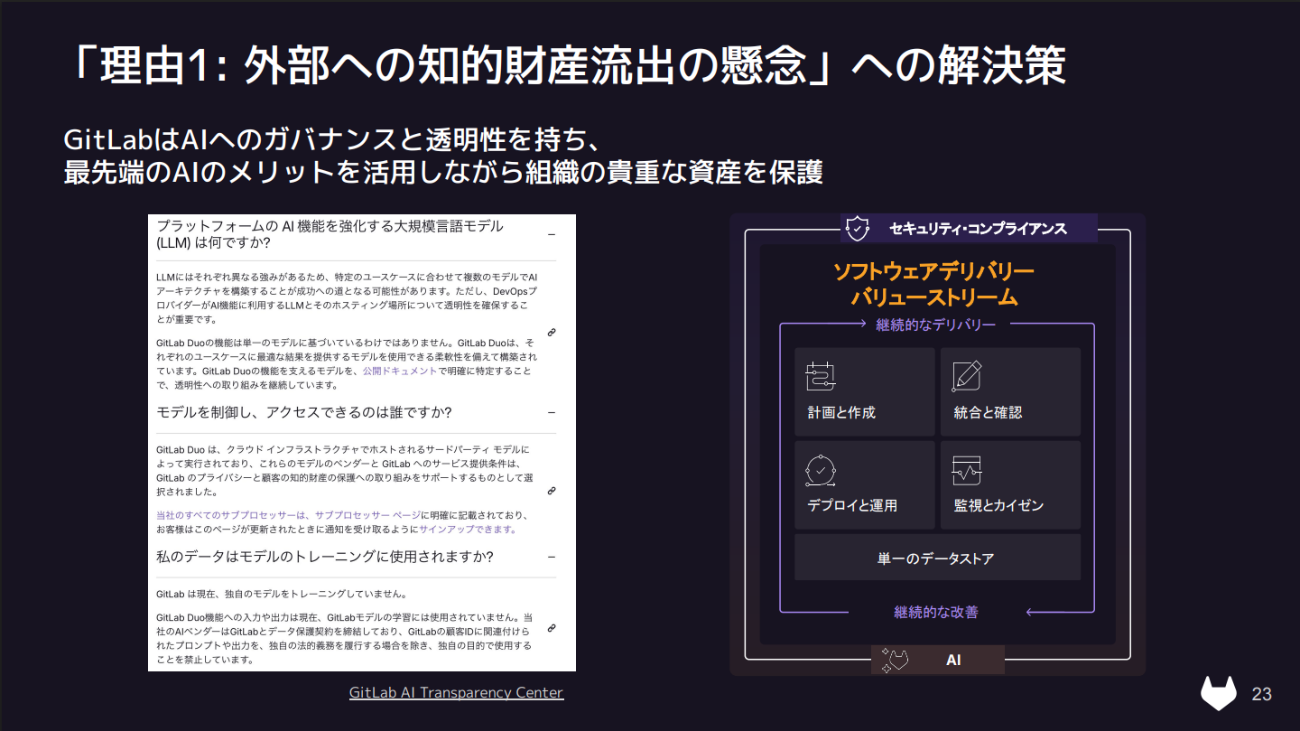

第1の懸念である、知的財産の外部流出については、事業者のモラルと透明性の確保、そして利用者がコントロールできる選択肢を増やすことが不可欠だという。GitLabでは、プライバシーファーストを掲げ、顧客のコードをAIの学習データとして使用しないことを保証(※)しており、学習を許可するオプトインオプションも存在しない。

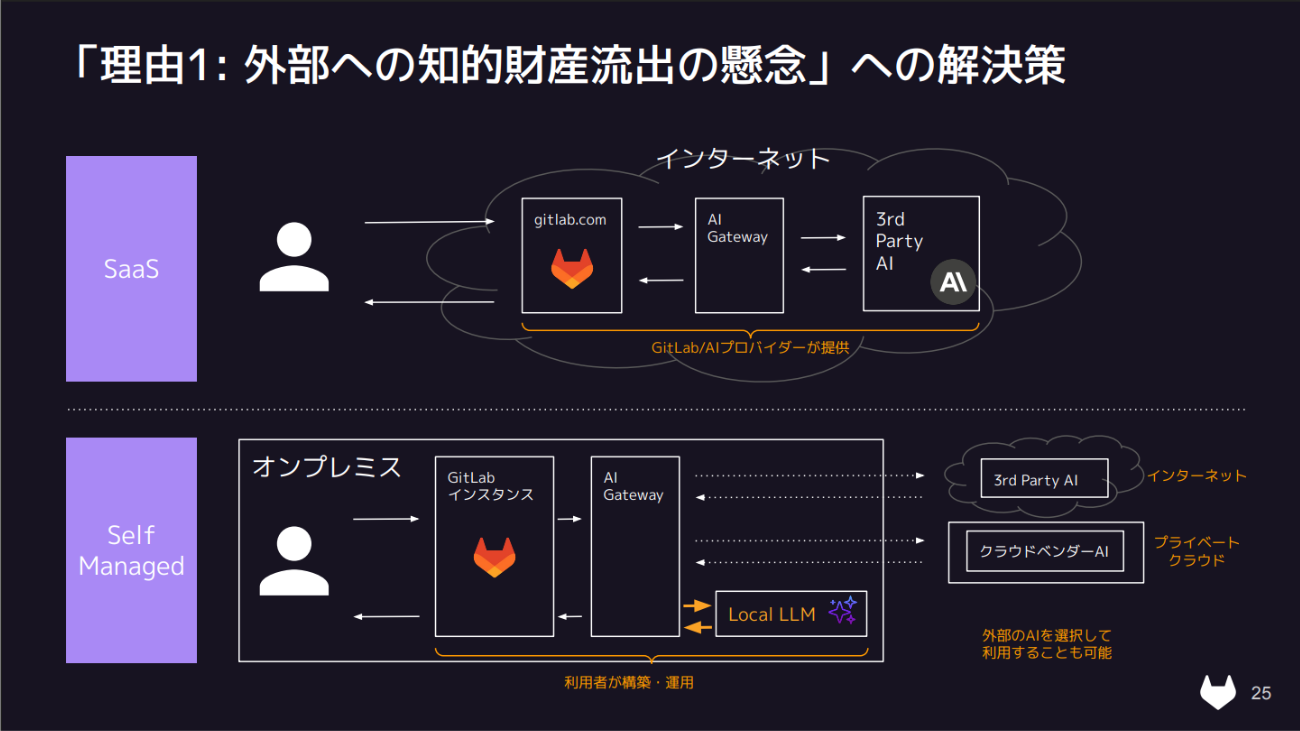

さらにSaaS版だけでなく、パッケージ版も提供しているので、自社のクラウドやオンプレミス環境にGitLabを構築することも可能だ。その場合、例えばAWS Bedrockや、ローカルLLMとの統合も可能になる。このような多彩な選択肢をGitLabが提供することで、企業は自社のセキュリティポリシーに合わせて、外部への情報流出リスクをコントロールすることができると、佐々木氏は言う。

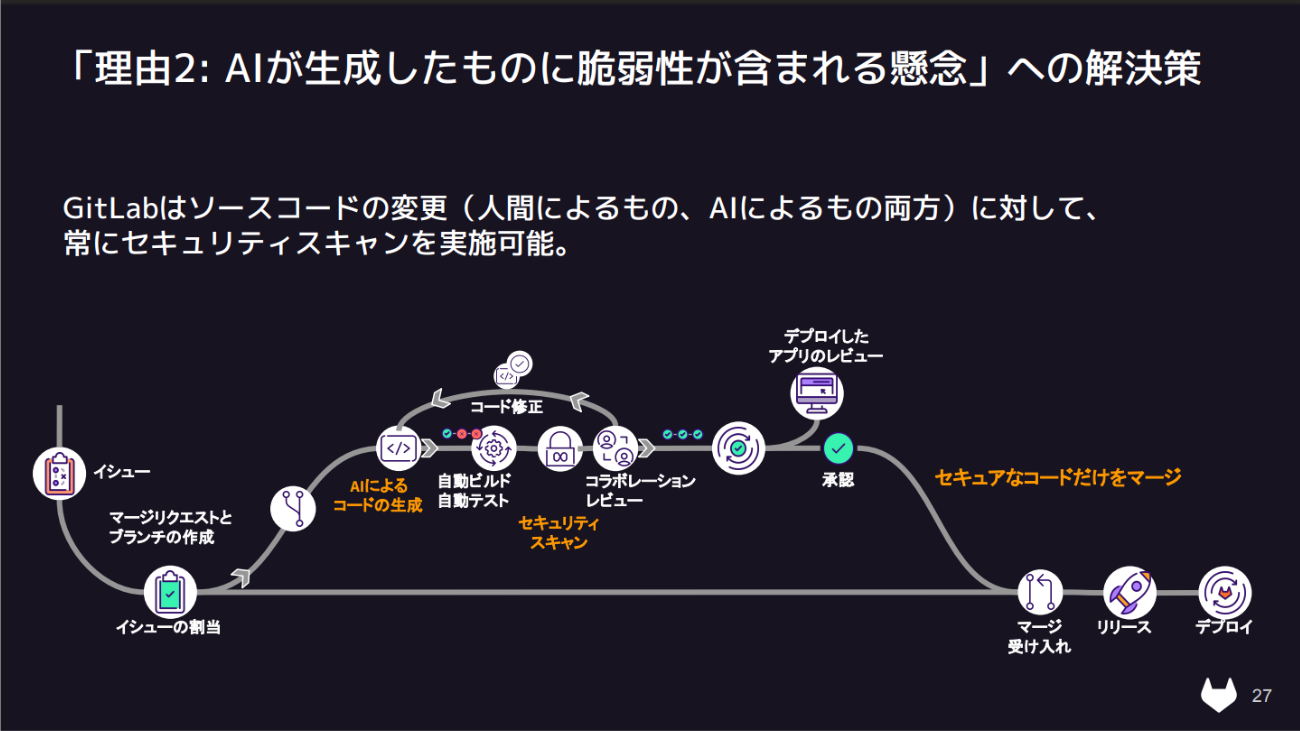

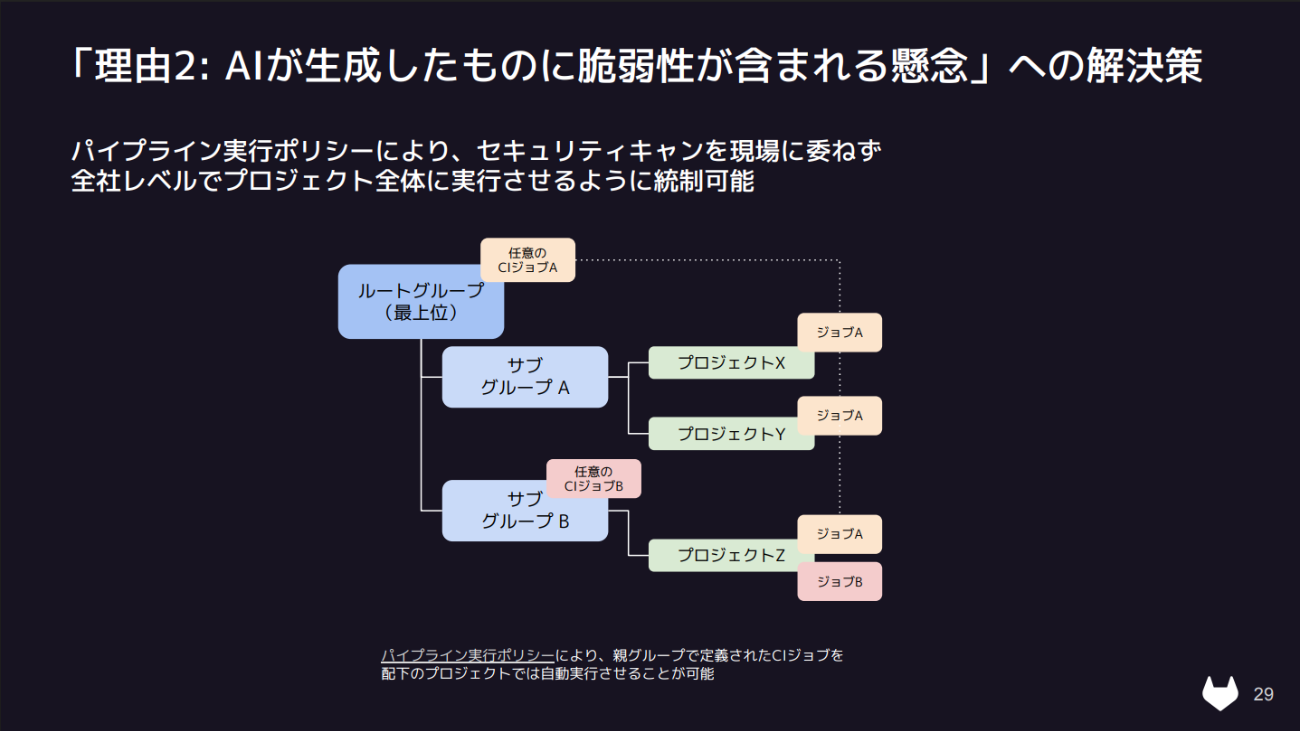

第2の懸念である、生成物の信頼性については、セキュア・バイ・デザイン、セキュリティスキャン、シフトレフトといった、人間によるソフトウェア開発に適用される対策をAIにも適用することで対応している。GitLabでは、ソフトウェア開発にAIが活用されるようになる前からDevSecOpsの中核機能としてセキュリティスキャンを提供しており、マージリクエストの作成時に、脆弱性が含まれるライブラリやコンテナイメージ、バッファオーバーフローなどのリスクを自動でチェックする仕組みをパイプラインに組み込める。 このスキャンは、AIが生成したコードにも人間が書いたコードにも等しく、かつ強制的に適用されるため、脆弱性を含んだコードがリポジトリに混入するのを防ぐことができる。

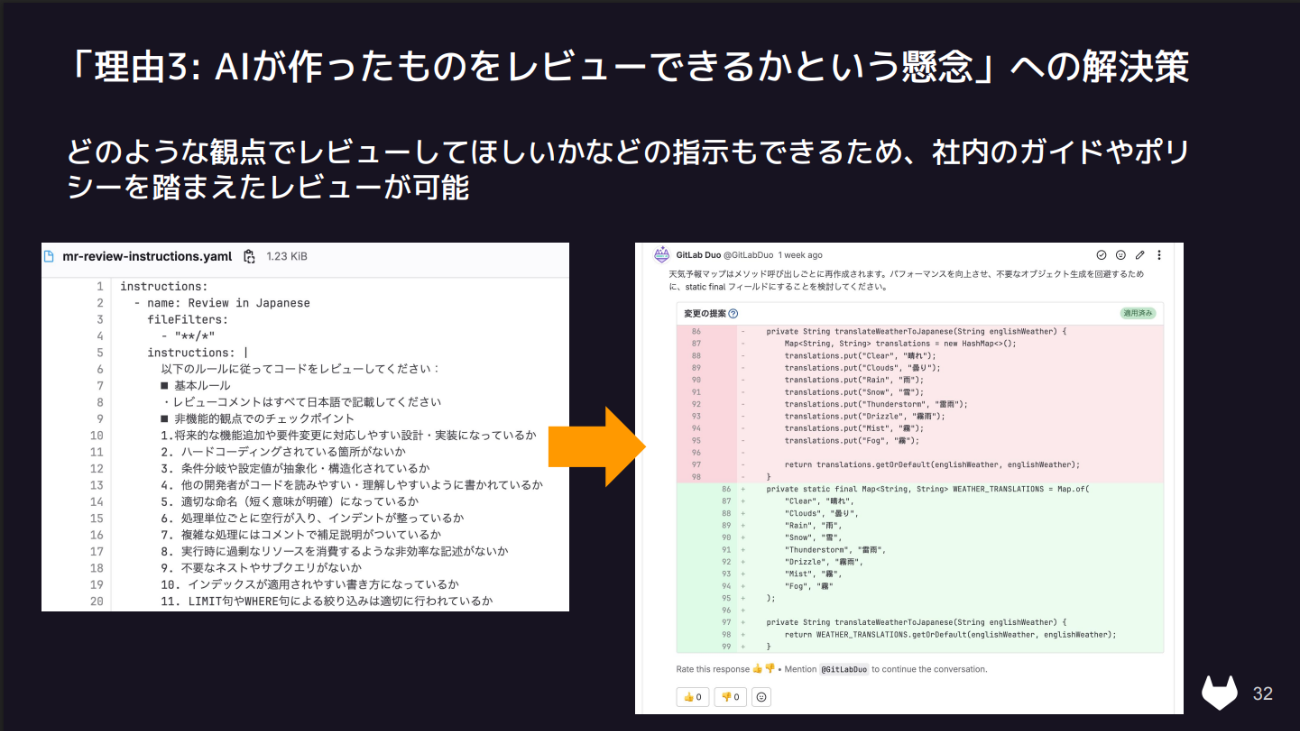

最後に第3の懸念である、人間によるレビュー能力の限界については、レビュー自体にもAIを活用することで解決を図る。ソフトウェア開発におけるレビューは多角的な観点から実施されるが、中でもプログラミング言語やフレームワークに関する技術的観点でのレビューには高度な専門知識が要求され、有識者のリソース不足がしばしばボトルネックとなる。佐々木氏は、このような専門知識を要するレビュー業務こそAIの得意分野であり、AI活用によってレビュー負荷の大幅な軽減が実現できると指摘している。

また、GitLab Duoは、各チームに存在するレビューの観点やルール、チェックリストなどをYAML形式で記述し、それらの指示に基づきAIにチェックさせることが可能だ。この仕組みにより、細かなソースコードの変更であっても、チームや組織に設定されたルールに基づいて自動的にチェックが実行される。

GitLab Duoを紹介するウェビナー開催!

記事内で登場したGitLab Duoをご紹介するだけでなく、コーディング支援に留まる限定的なAI活用、AIが生成するコードに潜む脆弱性の検知と排除、そして現場で発生する予期せぬ知的財産の流出リスクといった、AI活用がスタンダード化する過程で浮上した新たな課題の解決方法についてもお伝えします! ソフトウェア開発におけるAI活用を実践・検討中の方におすすめです!10月8日(水)15時から開催いたします。