AI導入における漠然とした不安の正体

最初に佐々木氏は、GitLabの概要とAIによる開発支援機能について紹介した。GitLabは、ソフトウェア開発ライフサイクル全体を支援する統合プラットフォームだ。単なるGitリポジトリ管理ツールに留まらず、チケット管理、CI/CD、セキュリティスキャン、さらには生産性分析といった機能を単一のプラットフォーム上で提供している。

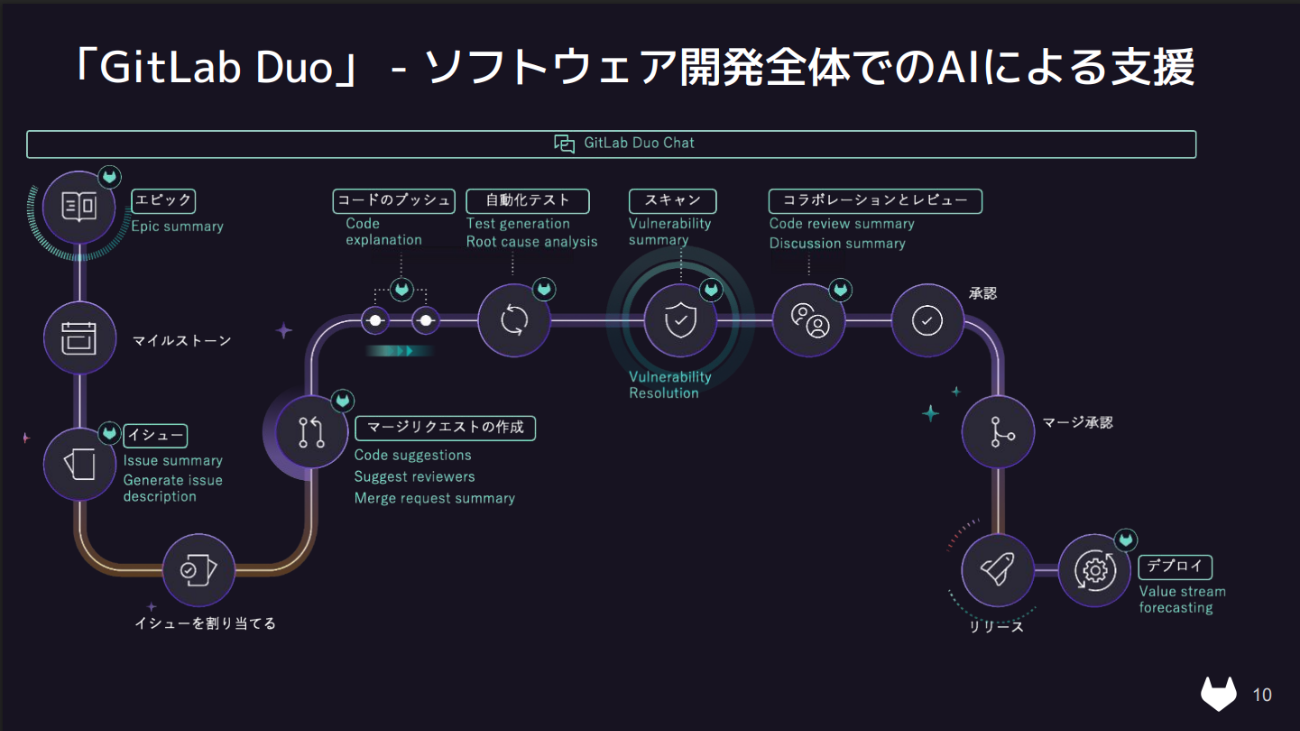

そして、GitLabのAI開発支援機能がGitLab Duoだ。GitLab Duoの特徴は、AIによるソースコード生成だけでなく、メンバー間の議論の内容や開発の進捗といったソフトウェア開発ライフサイクル全体のコンテキストをAIが理解し、チームの一員のようにサポートする点にある。例えば、CI/CDの失敗の原因の特定や、議論の内容を反映したコードの生成が可能だ。佐々木氏は「GitLab Duoは、チームメンバーの一人ひとりに寄り添い、伴走することをコンセプトにしているAIだ」と紹介する。

AIを活用した開発ツールが次々と登場する一方、開発現場への導入状況はどうだろうか。ここで佐々木氏は、2024年にGitLabがグローバルで実施した調査結果を紹介した。レポートによれば、ソフトウェア開発にAIを活用中、または活用予定と回答した組織は78%に上った。しかし佐々木氏は、実際にはPoCや検証段階の利用も含まれており、開発プロセスへの本格的なAI導入は進んでいないのではないかと指摘する。特に日本の多くの企業が、「AIによって出力される成果物の品質は大丈夫か」「自分たちのソースコードがAIのトレーニングに使用されてしまうのではないか」といった根深い不安を抱えており、日本での本格導入の割合は50%を切るのではないかと佐々木氏は推測する。

佐々木氏は、組織が抱える漠然とした不安感を、3つの具体的な懸念に分類した。

第1の懸念は、知的財産の外部流出だ。自社の機密情報やソースコードがAIの学習に使われ、意図せず他社の生成物として流出した場合、競争優位性を失いかねない。 佐々木氏によれば、一部のツールでは「トレーニングには使用しない」と謳いつつも、特定の条件下で学習データとしての利用を許可するオプションが存在し、エンジニアが意図せず情報流出させてしまうリスクが潜んでいるという。

第2の懸念は、生成物の信頼性だ。CSET(米国セキュリティ・新興技術センター)が発表したレポート「Cybersecurity Risks of AI Generated Code」では、5つの著名なLLMにコンテキストを一切与えずにコード生成を行わせる実験を行った。結果として、生成コードの約半数に、バグやセキュリティリスクが含まれていた。これは、AIがインターネット上に公開されたコードを学習していることに起因する。バグや脆弱性を含むコードも無差別に学習し、人間のミスまでも模倣してしまうのが現状だと、佐々木氏は指摘する。

そして第3の懸念が、人間によるレビュー能力の限界だ。AIはリソースさえあれば無制限に働くため、次々と成果物を作り出す。しかし、人間のリソースには限界があり、AIのように広範な知識も持ち合わせていない。 AIが生成した膨大なコードの品質やセキュリティ要件を、人間によるレビューですべて担保するのが困難で、その点が開発のボトルネックになる。

GitLab Duoを紹介するウェビナー開催!

記事内で登場したGitLab Duoをご紹介するだけでなく、コーディング支援に留まる限定的なAI活用、AIが生成するコードに潜む脆弱性の検知と排除、そして現場で発生する予期せぬ知的財産の流出リスクといった、AI活用がスタンダード化する過程で浮上した新たな課題の解決方法についてもお伝えします! ソフトウェア開発におけるAI活用を実践・検討中の方におすすめです!10月8日(水)15時から開催いたします。